如何有效解决全自动流水线调试过程中的常见问题

思路先行:把“自动化黑盒”拆开看

我这几年观察下来,绝大部分团队在全自动流水线调试上吃的苦,其实不是技术不行,而是把流水线当成一个“大黑盒”:出问题就盯着日志干看,却缺少系统化的拆解思路。我的经验是,先别急着追每一条报错,而是用“模块化 + 时间线”的视角,把流水线拆成若干清晰的阶段:触发与参数校验、代码获取与依赖安装、构建与静态检查、测试与质量门禁、制品打包与发布、环境部署与回滚准备。调试时只问一句:问题到底是发生在“之前”还是“之后”?用时间线把问题定位到某一个阶段,再用模块化结构去看对应阶段的输入、输出和依赖,是最省时间的办法。很多团队一上来就改脚本、换镜像,结果是把问题从一个阶段“赶”到另一个阶段,日志越滚越多。我的做法是先用简单手段验证:同一提交在不同分支、不同环境是否复现;同水线在不同参数下是否正常。通过对比法把问题缩小到“是否和环境耦合”“是否和代码变更耦合”,再决定是查流水线,还是查业务代码。

关键建议:真正能落地的几件事

建议一:把流水线当“系统”,而不是一堆脚本

流水线一旦发展到自动化、全链路、跨环境执行的阶段,靠零散脚本和个人经验已经不现实了。我主张把流水线当成工程系统来治理:,把所有关键阶段抽象成“组件”,比如构建组件、测试组件、镜像构建组件、部署组件,每个组件只完成单一职责,并具备清晰的输入输出约定;第二,为每个组件定义稳定的接口和配置规范,比如统一使用环境变量传参,约定日志输出格式,而不是到处写硬编码路径和临时变量;第三,用版本化的方式管理流水线配置,如在代码仓库中维护统一的 pipeline 模板,关键变更必须通过代码评审。这么做的好处是,一旦某个阶段出问题,你知道它背后对应的是哪一个组件,谁负责维护,输入输出可以怎样快速重放验证,而不是在一长串 YAML 或 Shell 中到处搜索。长远看,这种“系统化”思路会大幅降低调试成本,也让新人更快接手复杂流水线。

建议二:日志要“结构化”,而不是“堆栈化”

流水线调试最常见的痛点就是日志:要么太少,看不到关键上下文;要么太多,堆满无用输出。我看过不少项目,流水线日志基本就是原生构建工具的输出,夹杂一堆颜色控制符、无意义的进度条信息,真正有用的信息反而被淹没。我更推荐做结构化日志:,为关键节点打统一格式的“阶段标记”,比如在每个阶段前后输出固定前缀的日志,方便用搜索或正则快速跳转到某个阶段;第二,对关键变量输出进行标准化,比如构建参数、环境变量白名单、依赖版本清单,不要只在出错时临时打印;第三,用日志等级和简要摘要,将最可能导致失败的错误消息收敛到最后几行,减少对滚屏日志的依赖。这样,当流水线失败时,你可以先看“摘要层”的日志判断大致方向,再按阶段标记快速定位到具体上下文,而不是从行往下翻。这种“结构化调试体验”,对跨团队协作尤其重要。

建议三:调试要可重放,而不是一次性

很多团队在流水线上犯的一个典型错误,是在失败现场直接手改脚本、重新跑整条流水线,希望“试一把就好了”。问题是,整条流水线往往长达十几分钟甚至数小时,而且每次构建环境、依赖状态都略有变化,导致你很难真正复现问题。我比较推崇的做法是建立“可重放调试流程”:,对每次构建的关键上下文做快照,比如提交哈希、参数、构建镜像版本、依赖缓存信息,确保同样的输入可以重新驱动同样的步骤;第二,为核心阶段提供本地或单步重放能力,比如在开发机或专用调试环境中只跑“构建 + 单元测试”这一段,而不是整个流水线;第三,对于复杂问题,可以固定一个“调试分支”或“调试流水线”,专门用于问题复现和实验,而生产流水线保持相对稳定。这种把调试从“一次性试错”变成“可脚本化重放”的方式,会让你之后每次遇到类似问题,都能快得多地验证解决思路,而不是从头摸索一遍。

建议四:配置和环境差异,要显性化管理

在我见过的流水线故障里,环境差异问题占了至少一半:开发环境、测试环境、预生产和生产之间,操作系统版本、容器镜像、基础依赖、网络权限稍有差别,就可能导致流水线“有时失败,有时成功”,调试起来特别抓狂。解决这个问题的关键是“显性化”:,用代码描述环境,尽量以容器镜像、基础镜像 Dockerfile 以及基础设施即代码的方式固化环境,而不是靠 wiki 抄配置;第二,建立环境基线检查机制,在流水线早期阶段自动输出核心环境信息,如系统版本、关键工具版本、网络探测结果,一旦偏离预期就快速失败,而不是等到后面的随机错误;第三,对敏感配置集中管理,比如数据库连接、云凭证、第三方服务密钥,统一交给配置中心或密钥管理系统,流水线只通过标准接口获取,而不是每个作业里各写一份。把环境差异从“隐性风险”变成“显性对象”,才能在问题出现时有据可查,而不是靠印象猜测到底哪里不一样。

建议五:建立最小可用调试闭环,避免“大工程”思维

不少团队一谈改进流水线调试,就想着上全面可视化平台、统一度量系统、各种智能分析,结果项目一拖再拖,日常问题还是靠人肉排查。我更倾向于先建立“最小可用调试闭环”:即选定一条最关键的业务流水线,从三个点做小而快的改进:,给关键阶段补充阶段标记和摘要日志,让每次失败都能马上知道是卡在哪一段;第二,增加一个简单的“重放脚本”,在独立环境中复现构建与测试,比如通过单独的 CI 任务或本地 Docker 命令实现;第三,拉一份最近一两个月的失败记录,用标签归类,明确 2~3 类最常见的失败原因,并针对性地加校验或早期失败。这样做的好处是,一两周内你就能感受到调试效率的提升,不至于因为目标太大而停留在设想阶段。等这个闭环跑顺了,再考虑接入更复杂的平台化、观测和智能分析工具,节奏会更自然,也更容易说服管理层投入。

落地方法与推荐工具

落地方法一:用“模板化流水线”固化更佳实践

要让上述建议真正落地,我会先做一件非常具体的事:在代码仓库中引入“流水线模板”,作为团队范围的默认选项。具体做法是:,挑选现有最稳定的一条流水线,抽取出通用阶段,例如检出代码、依赖安装、构建、测试、制品打包和部署,将这些步骤拆分到单独的脚本文件中,并在脚本里增加结构化日志输出和必要的环境检查;第二,在 CI 平台(比如常见的 Jenkins、GitLab CI 等)上声明一个统一的模板配置,把这些通用脚本组合起来,参数化项目特有的部分,如语言、依赖管理工具、目标环境等;第三,强制所有新项目优先使用该模板,并逐步推动老项目迁移,在迁移过程中同步清理历史遗留的混乱脚本。这个过程一开始会有一点阵痛,因为要“统一约定”总会触动各自为战的习惯,但只要用几个项目的实际收益拉齐预期,比如故障定位时间和重复问题数量的明显下降,团队很快就会认可这种模板化带来的调试便利。

落地方法二:借助可视化流水线工具提升调试效率

在工具层面,我常推荐优先选用具备“可视化阶段视图”和“日志聚合能力”的平台,例如 Jenkins 配合 Blue Ocean 插件,或 GitLab CI 自带的流水线视图。关键不是追求多酷炫的界面,而是利用这些工具的几个具体能力:,分阶段展示执行状态,一眼看到是在哪个 Job 或 Stage 失败,避免在一长串日志中迷路;第二,支持按阶段下载和搜索日志,配合前面提到的结构化日志实践,让调试过程更接近“查表”而不是“翻书”;第三,提供重跑单个任务或从中间阶段重新执行的能力,结合上下文快照,可以快速做可控的重放调试。这类工具并不会神奇地替你解决所有问题,但它们能显著降低信息获取成本,让你把精力用在分析问题根因和优化流程上,而不是在流水线上反复点来点去。说白了,工具是为了让你的调试思路跑得更顺,而不是堆砌新概念。

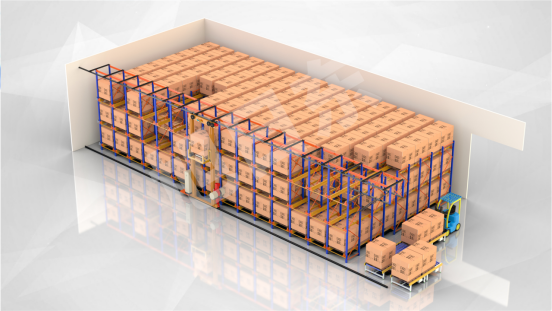

TAG: 电池全自动生产线 | 全自动生产装配线 | 全自动流水线厂 | 立体全自动地仓库 | 全自动码垛生产线 | 全自动智能仓库 |

深圳市龙华区观澜街道牛湖社区裕昌路95号

东莞市塘厦镇新太阳科技产业园208栋

0755-89500671 0769-82861482 0769-82862446

13600198971(李先生)

18002572882(张女士)

13603036291(刘先生)

13786148083(吴小姐)

4977731621@qq.com

返回列表

返回列表